Эксперт поделился информацией о возможности взлома ChatGPT — Wired

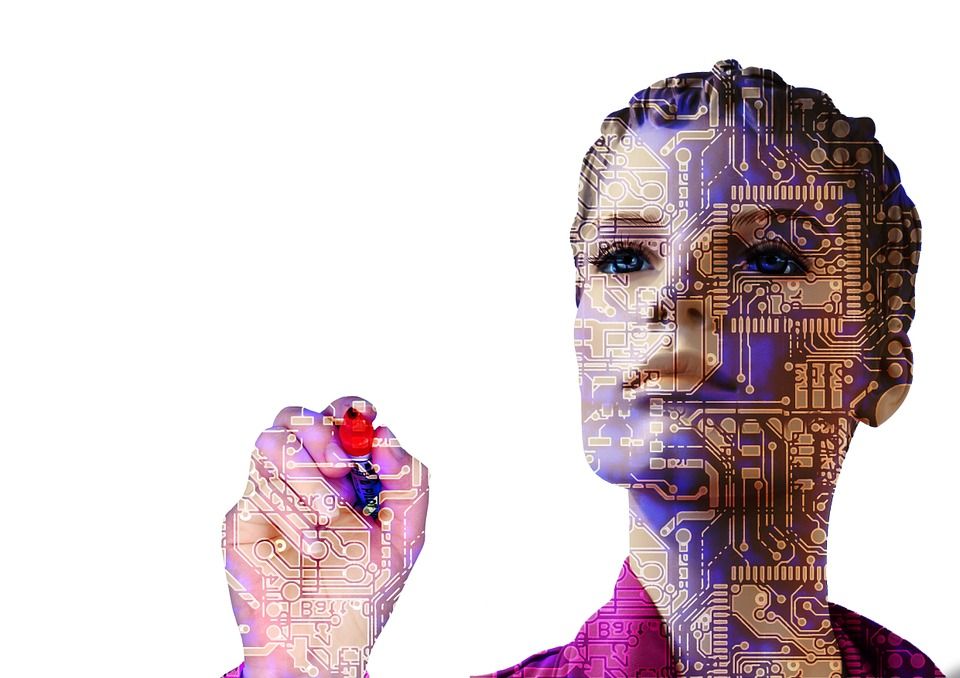

Проблемы с безопасностью языковой нейросетевой модели GPT-4 могут позволить злоумышленникам получить доступ к важным данным или провести кибератаку, заявил специалист по компьютерной безопасности Алекс Поляков, 15 апреля сообщает американский журнал Wired.

По данным издания, Алекс Поляков за несколько часов сумел взломать GPT-4, обманув систему безопасности OpenAI. Эксперт создал универсальный «джейлбрейк» (применение уязвимостей для получения возможности установки программного обеспечения на атакуемую систему).

Уязвимость касается большинства языковых моделей, включая GPT-4, Bing от Microsoft, Bard от Google и Claude от Anthropic.

Издание отмечает, что производители нейросетевых моделей типа GPT уже работают над созданием систем, позволяющих обнаруживать джейлбрейки и атаки с внедрением подсказок.

Читайте также: Бот ChatGPT может дать информацию для совершения преступлений — эксперт