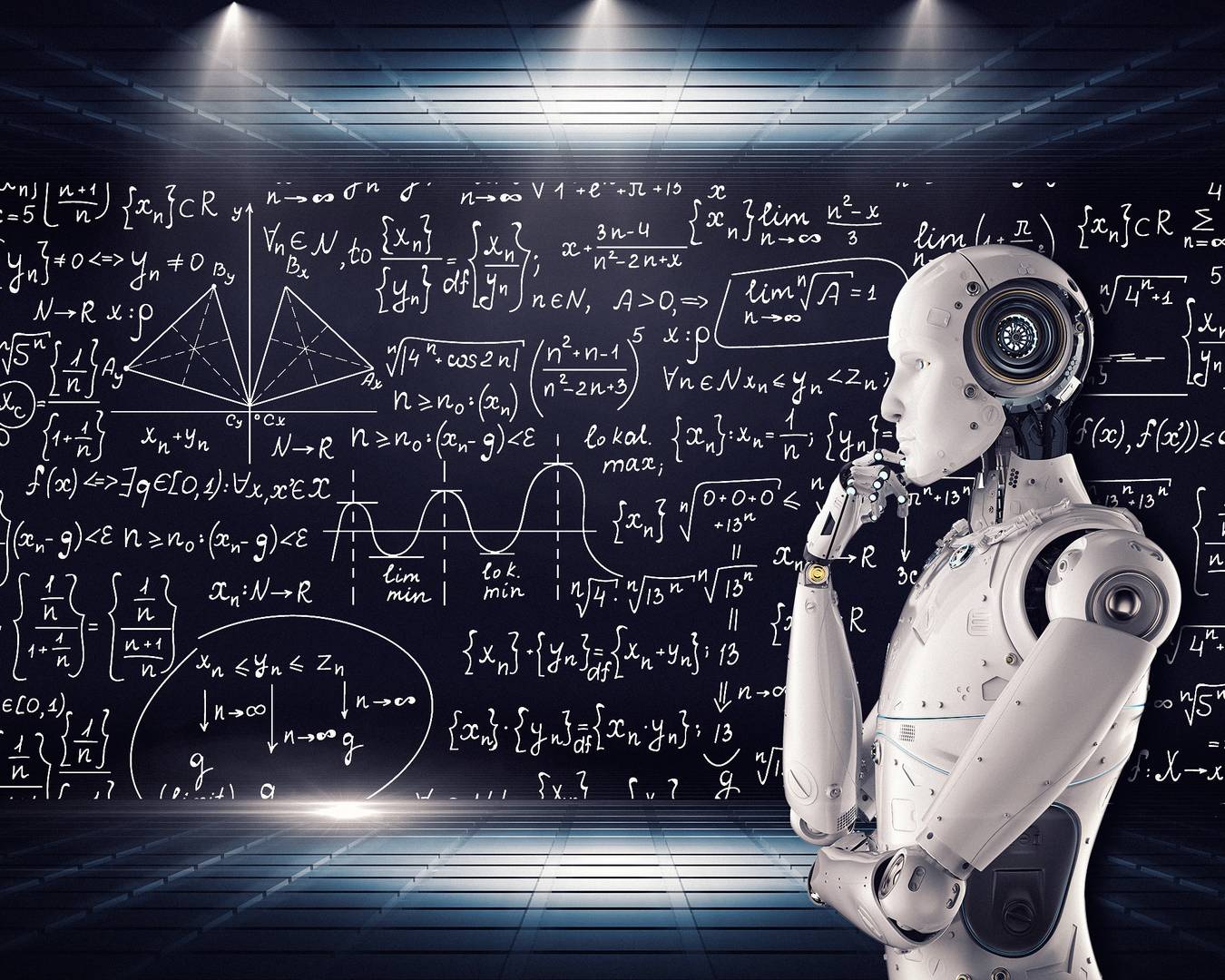

Ученые МГУ выявили слабые места применения машинного обучения в приложениях

Главное препятствие при использовании моделей машинного обучения в критических приложениях — это проблемы с устойчивостью алгоритмов данного класса к внешним воздействиям, установили исследователи факультета вычислительной математики и кибернетики (ВМК) МГУ, 1 апреля сообщает пресс-служба университета.

Результаты исследования, проведенного участниками научно-образовательной школы МГУ «Мозг, когнитивные системы, искусственный интеллект» в рамках тематики «Искусственный интеллект в кибербезопасности», были приведены в статье «Атаки на системы машинного обучения — распространенные проблемы и методы», опубликованной в International Journal of Open Information Technologies.

Машинное обучение стало практически синонимом термина «искусственный интеллект», а программы его развития во многих странах являются национальными. При этом добавлять в приложения возможности машинного обучения стало настолько просто, что уже не требует глубоких знаний в этой области.

Исследователи указали, что в своей работе они рассматривали проблему состязательных атак на системы машинного обучения, то есть преднамеренных действий над элементами конвейера машинного обучения, таких как обучающие данные, сама модель и, тестовые данные, с целью добиться желаемого поведения системы или не дать ей работать корректно.

Проблема эта, указывают авторы, является следствием принципиального момента для всех систем машинного обучения, заключающегося в том, что данные на этапе тестирования или эксплуатации отличаются от тех данных, на которых производилось обучение системы.

Вследствие этого нарушения в системе машинного обучения может возникнуть без каких-либо целенаправленных действий, просто потому, что для данных, введенных в приложение на этапе эксплуатации, не работает обобщение, достигнутое на этапе обучения.

Атака на систему машинного обучения в общем случае — это целенаправленное введение системы в область данных, на которой она не обучалась. Возможность таких атак, называемых состязательными, является основным препятствием для использования машинного обучения в критически важных приложениях, то есть таких, от успешности работы которых, например, серьезно зависит возможность существования организации или выполнения ею своего назначения.

Для того чтобы противодействовать таким атакам, считают исследователи, необходимо их классифицировать, выявлять их типы и места приложения, так как природа атак на системы машинного обучения и глубокого обучения иная, чем в случае других киберугроз. Например, атаки, направленные на извлечение параметров модели.

«Эта информация поможет атакующему создать обманывающие систему примеры. Существуют атаки, которые позволяют проверить, например, принадлежность определенных данных к тренировочному набору и, возможно, раскрыть тем самым конфиденциальную информацию», — рассказал Евгений Ильюшин, сотрудник кафедры информационной безопасности факультета ВМК МГУ.

Дмитрий Намиот, старший научный сотрудник кафедры информационной безопасности факультета ВМК МГУ, добавил: «Состязательная атака часто используется в широком смысле для обозначения различных типов злонамеренных действий против моделей машинного обучения. Возможности обнаружить их с помощью классических инструментов, используемых для защиты программного обеспечения от киберугроз, нет».

В своей работе ученые приводят примеры возможной классификации состязательных атак и делают вывод о необходимости сертификации систем, моделей и наборов данных, подобно тому, как это делается для традиционных систем программного обеспечения.

Это тем более необходимо из-за того, что состязательные атаки вызывают проблемы с доверием к алгоритмам машинного обучения, особенно к глубоким нейронным сетям. Дискуссии об этике систем искусственного интеллекта связаны, в том числе, и с состязательными атаками, подчеркивают исследователи в своей статье.