ChatGPT опасно использовать в качестве судьи. Мнение

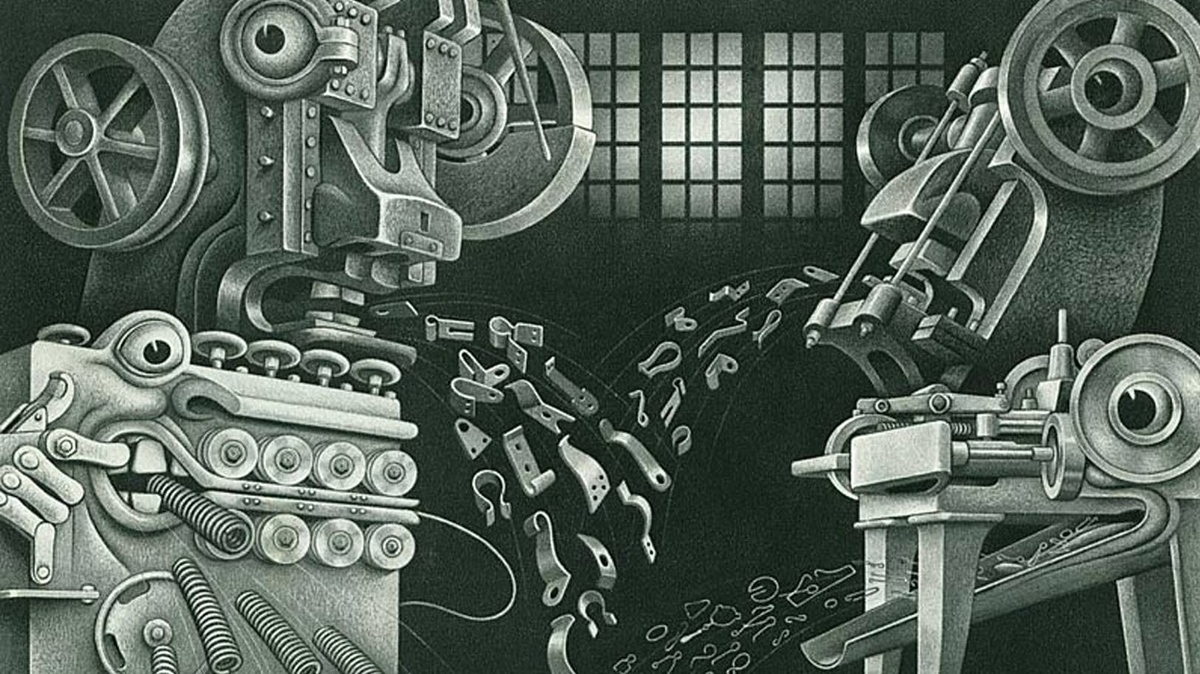

Использование искусственного интеллекта в качестве судьи может привести к большим ошибкам, заявил 3 февраля обозреватель IT-редакции ИА Красная Весна Михаил Костенчук.

В Колумбии судья при вынесении судебного приговора «советовался» с чат-ботом на искусственном интеллекте ChatGPT и более того, включил свой диалог в постановление, что вызвало негативную реакцию в обществе.

Эта реакция справедлива, считает Костенчук. «На текущий момент чат-бот ChatGPT представляет угрозу в первую очередь для поисковых систем и может претендовать скорее на их роль, чем на роль судьи», — отметил он.

Если при использовании поисковой системы человек в итоге всё равно получает информацию из источника и может оценить его достоверность, то в случае использования ChatGPT достоверность информации недоказуема.

«На текущий момент это наиболее критичный недостаток больших языковых моделей. Они собирают много информации и стыкуют разные ее части между собой. Но в этом процессе отсутствует осмысленность соединения этих информационных блоков. И получаются порой очень нелепые высказывания, когда бот предлагает, например, кормить ребенка истолченным фарфором», — отметил Костенчук.

Напомним, популярность ChatGPT привела к тому, что оставившие работу в Google Ларри Пейдж и Сергей Брин провели несколько встреч с топ-менеджерами корпорации. Главной темой обсуждения стала угроза для поискового бизнеса Google, которая исходит от чат-бота.

1 февраля стало известно, что Брин начал работу над аналогом ChatGPT.