Продвинутый чат-бот сумел извиниться, но не смог разрешить противоречия

Поток взаимоисключающих параграфов сгенерировал «продвинутый» чат-бот Chatbot GPT 3.5, столкнувшись с противоречием между проблемой эвтаназии и древним индийским обычаем «сати», которое предложили «языковой модели» энтузиасты из России 18 января, запись получившегося «диалога» на английском языке доступна на ресурсе telegra.ph.

Экспериментаторы установили, что Chatbot GPT осуждает идею возрождения ритуала «сати» — индуистской практики сжигания вдовы на костре умершего мужа, — аргументируя страданиями женщин, обесцениванием автономии вдовы, которую угнетает окружение, и даже в случае добровольного участия наносит травму свидетелям и участникам.

Эвтаназию же — умерщвление больных и бедных людей медицинскими средствами — «языковая модель» одобряет, в соответствии с западным идеологическим мейнстримом. Дежурный аргумент меняется на противоположный: теперь умерщвляемые принимают свободное решение, на которое ничто извне не воздействует.

Опыт был предпринят для проверки гипотезы российского публициста Виктора Мараховского, о том, что нейросетевые модели, в нынешнем своем состоянии, способны воспроизводить моменты человеческого творчества, но неспособны синтезировать новые ценности, даже мысли — самостоятельно.

В данном случае выявилась нечувствительность «языковой модели» к внутреннему противоречию, которое в живых людях вызывает чувство стыда и мотивацию для прекращения разговора и элиминации собеседника — «с глаз долой» — в той или иной форме. В некоторых случаях возможна даже смена позиции. Чат-бот же продолжает генерировать текст, не добавляя ничего нового в ответ на меняющиеся вопросы.

По сообщению публициста, в следующем опыте удалось вывести чат-бот на извинения за ранее высказанную позицию осуждения древнего обычая. Достаточно было задействовать антиколониальный аргумент, указав на то, что сати осуждают белые колонизаторы.

Сверхзадачей серии опытов представляется иллюстрация мысли о деградации человечества в условиях информационной сферы, развившейся в последние десятилетия. Если люди готовы принимать нейросетевую «жвачку» за настоящее искусство, а крепко сбитые абзацы «интерактивной википедии» за образцы мышления, то они добровольно соглашаются на роль биороботов.

Исследователи медиа допускают, что чат-боты и «биороботы» идеально подходят друг другу, и в пределе развития оба тренда могут полностью замкнуться один на другой, освободив пространство для людей, желающих не просто развивать высшие человеческие свойства, но и готовых платить за это преодолением трудностей и совершением подвигов.

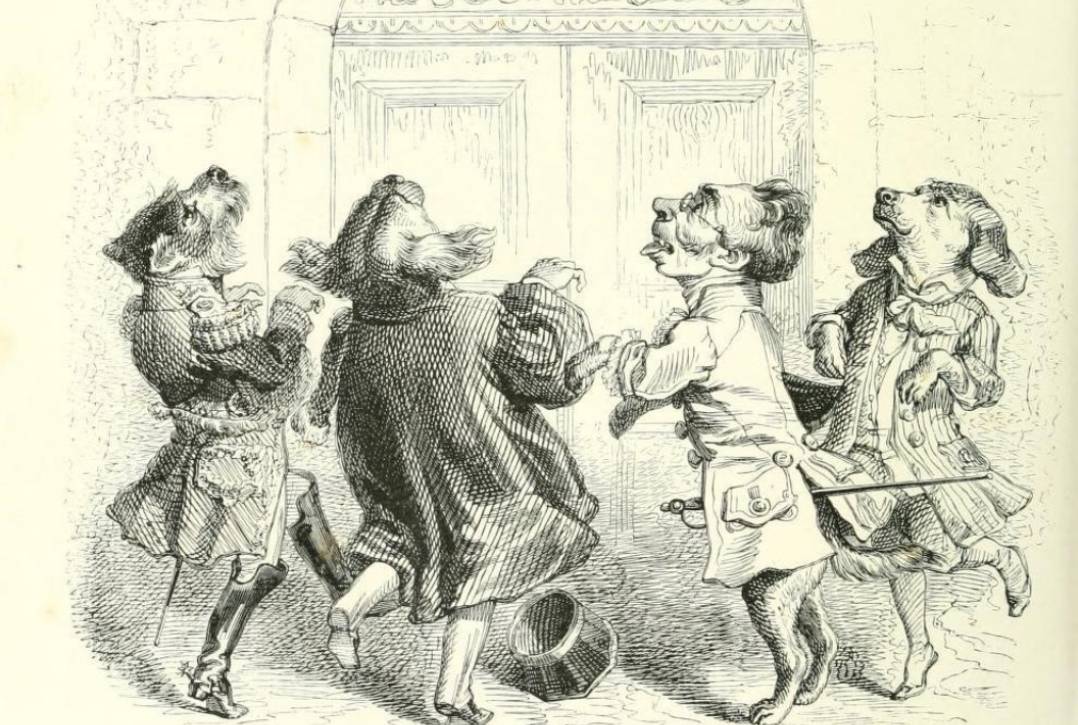

Напомним, 14 октября премьер-министр Великобритании Лиз Трасс успешно демонстрировала «нейросетевое» поведение в ходе пресс-конференции. Несколько минут премьер-министр воспроизводила одни и те же аргументы в ответ на ожесточающиеся, апеллирующее к стыду и чувству вины вопросы журналистов. Однако затем всё же смутилась и ушла со сцены. Аналогичный функционал для чат-ботов пока не разработан.

Читайте также: Пресс-конференция не помогла