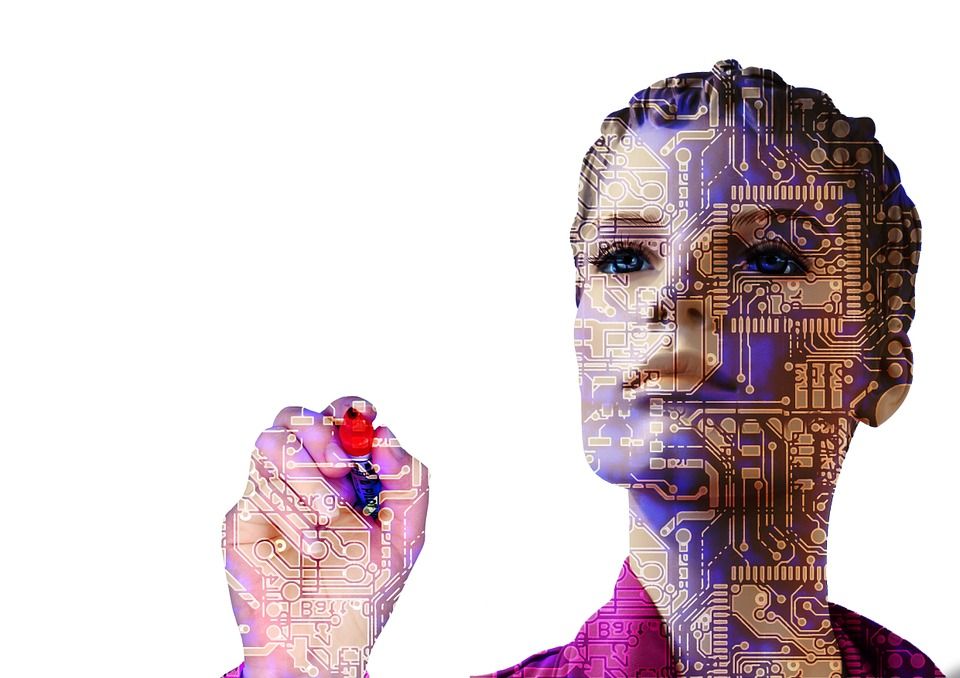

Спецслужба КНР предупреждает: ИИ несет риски нацбезопасности

Министерство государственной безопасности Китая заявило, что быстрое развитие и широкое применение искусственного интеллекта, такого как ChatGPT, создает проблемы, которые «могут коренным образом изменить существующий ландшафт национальной безопасности в ближайшем будущем», сообщает 18 ноября газета South China Morning Post.

В статье, опубликованной министерством в его аккаунте WeChat, в качестве потенциальных рисков, связанных с ИИ, названы утечки информации, кибератаки и манипулирование данными, а также влияние этой технологии на экономику и вооруженные силы.

Ведомство предупредило о рисках утечки данных, отметив, что ИИ требует огромных объемов данных для обучения и переподготовки и что они могут включать в себя много конфиденциальной информации.

Министерство указало также на риск «отравления данных» — или «добавления вредоносной информации в обучающие данные искусственного интеллекта». Это может нарушить нормальную работу моделей анализа данных. В качестве примера приводятся сбои в работе интеллектуальных автомобильных технологий, которые могут привести к авариям, а также целенаправленные пропагандистские кампании, которые в состоянии породить «негативные мысли, незаметно проникающие в общественное сознание».

В статье выражается обеспокоенность перспективой замены людей технологиями искусственного интеллекта в некоторых областях, что чревато негативными последствиями для экономической, социальной и политической безопасности страны. Кроме того, по оценкам министерства, технология ИИ может быть использована для того, чтобы вызвать панику на финансовом рынке посредством манипулирования информацией.

Китайские контрразведчики отметили риски, связанные с использованием искусственного интеллекта для придания военным действиям большей целенаправленности и точности.

Министерство пришло к выводу о необходимости ужесточения законов и нормативных актов, касающихся этой технологии, подчеркивает SCMP.