Чтобы допустить ИИ до ядерной безопасности, нужен материал для обучения…

Дискуссия об использовании ИИ в области принятия решений о ядерном нападении натолкнулась в США на нехватку материала для обучения ИИ данной проблематике — опыт практического применения ядерного оружия маловат, 24 января сообщает Breaking Defense.

Дискуссия о допуске ИИ к анализу предварительной информации о ядерном нападении в интересах людей, принимающих решение о ядерном ответе, натолкнулась на неожиданное препятствие. Практическая проблема состоит в том, что для обработки первичных данных для американской Системы ядерного командования, контроля и связи (NC3) ИИ необходимо вначале обучить на каком-то информационном массиве. Например, на практике применения ядерного оружия, но этот объем информации ограничен всего двумя случаями 1945 года, когда бомбы приходилось сбрасывать с винтовых самолетов.

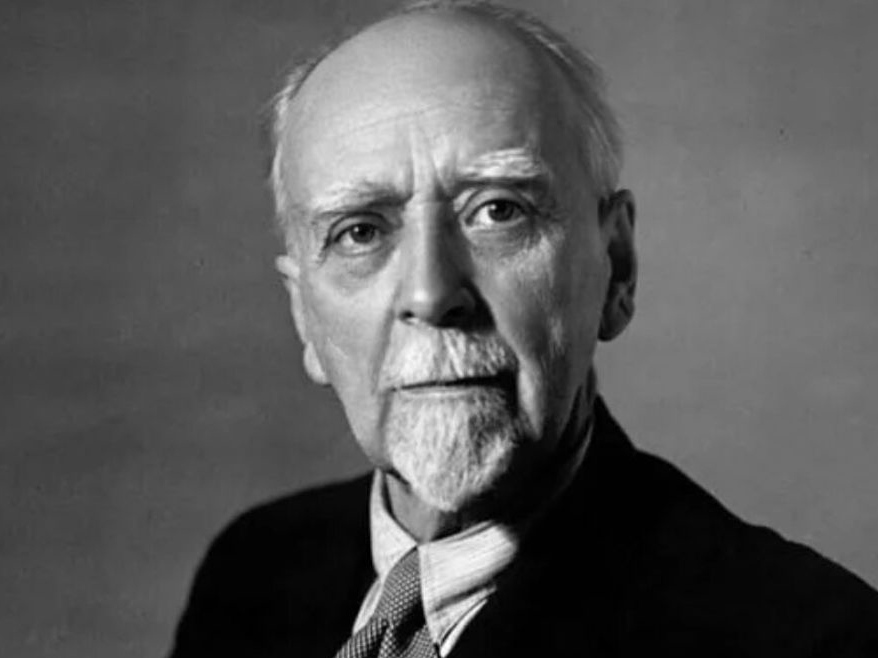

«Какой набор данных для обучения ИИ мы будем использовать в вопросах ядерной войны? У нас его нет. К счастью…» — сказал Пол Шарре, бывший армейский рейнджер, который возглавлял рабочую группу министерства обороны по разработке политики автономности в системах вооружений, и недавно опубликовал книгу боевых перспективах ИИ.

Алгоритмам ИИ требуются горы данных для обучения, но и тогда они, как известно, страдают некоторой зыбкостью своего аналитического инструментария.

«Люди могут гибко реагировать на новые условия, а ИИ — нет, —сказал Шарре. — Системы ИИ кошмарно адаптируются к новизне. Если им представить ситуацию, выходящую за рамки их базовых данных, они фактически сходят с ума, не обладая способностью к адаптации».

В результате, по его словам, ядерный кризис — это именно та ситуация, в которой мы и ожидаем с наибольшей вероятностью катастрофического отказа систем ИИ.