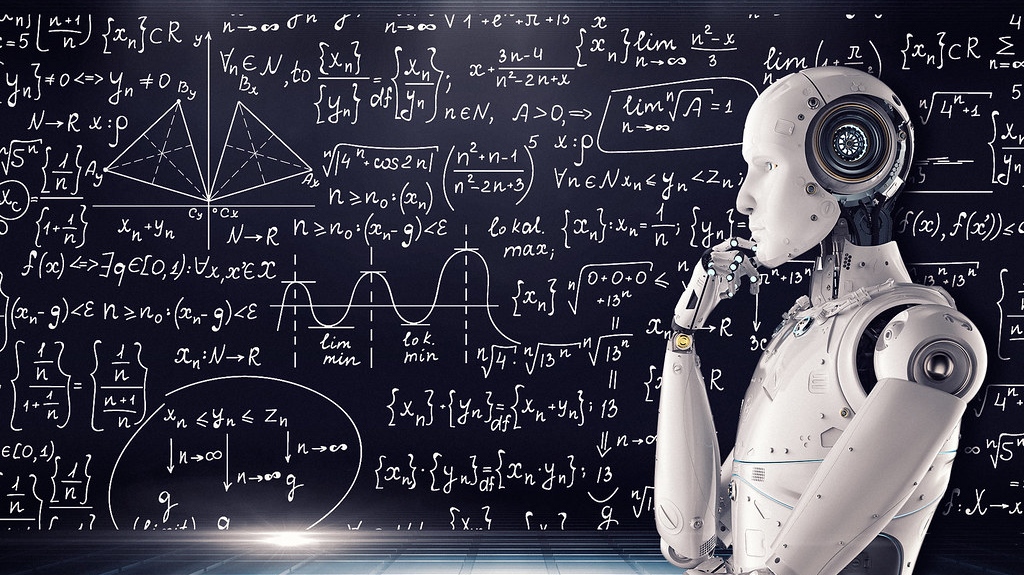

В Китае предложили создать систему борьбы с преступлениями ИИ

Создать комплексную систему управления для борьбы с преступлениями, совершаемыми с использованием технологий искусственного интеллекта, предложили эксперты Пекинского муниципального бюро общественной безопасности, сообщает 9 января издание Yicai.

Специалисты написали доклад в котором изложили предложение для властей Китая, т. к. в последнее время количество преступлений с использованием ИИ начали стремительно рости. Преступники могут совершать мошенничества с использованием искусственного интеллекта для глубокой подделки или изменения голоса, что более достоверно, чем традиционные методы, и затрудняет жертвам распознавание схем, говорится в докладе, опубликованном в журнале Китайской академии наук 7 января.

Кроме того, возможны самостоятельные преступные действия, вызванные автономными системами вождения, воплощенным интеллектом в роботах или другими системами искусственного интеллекта, отмечают эксперты. В более сложных сценариях реального мира интеллектуальные агенты, принимающие решения, могут нарушать некоторые базовые принципы, заранее установленные человеком, что отличает преступления с использованием ИИ от традиционных преступлений. «В обозримом будущем число преступлений с использованием технологий ИИ будет расти, создавая значительные проблемы для социального управления», — подчеркивают эксперты.

По данным исследования компании 360 Security Technology, также известной как Qihoo 360, приведенным в докладе, в прошлом году число мошенничеств с использованием искусственного интеллекта выросло в 30 раз по сравнению с предыдущим годом, а количество фишинговых писем, сгенерированных искусственным интеллектом, увеличилось в 11 раз.

Эксперты предложили адаптировать законы и правила к развитию и применению технологий ИИ, внедрить механизм динамического обновления законодательства для периодического пересмотра соответствующих положений в соответствии с появляющимися технологиями. Также необходимо создать механизмы ответственности для разработчиков, поставщиков и пользователей ИИ, создать системы выявления и раскрытия преступлений, связанных с ИИ, проводить регулярный мониторинг и раннее предупреждение, разработать динамичный механизм классифицированного регулирования ИИ, повысить уровень подготовки талантов и международного сотрудничества.

Университеты должны открыть специализированные программы по ИИ, ориентированные на общественную безопасность, с упором на анализ практических случаев и обучение, создать специальную базу данных по преступлениям с использованием ИИ для обмена данными о преступлениях в режиме реального времени, чтобы эффективно пресекать такие трансграничные преступления, считают эксперты.

(теги пока скрыты для внешних читателей)