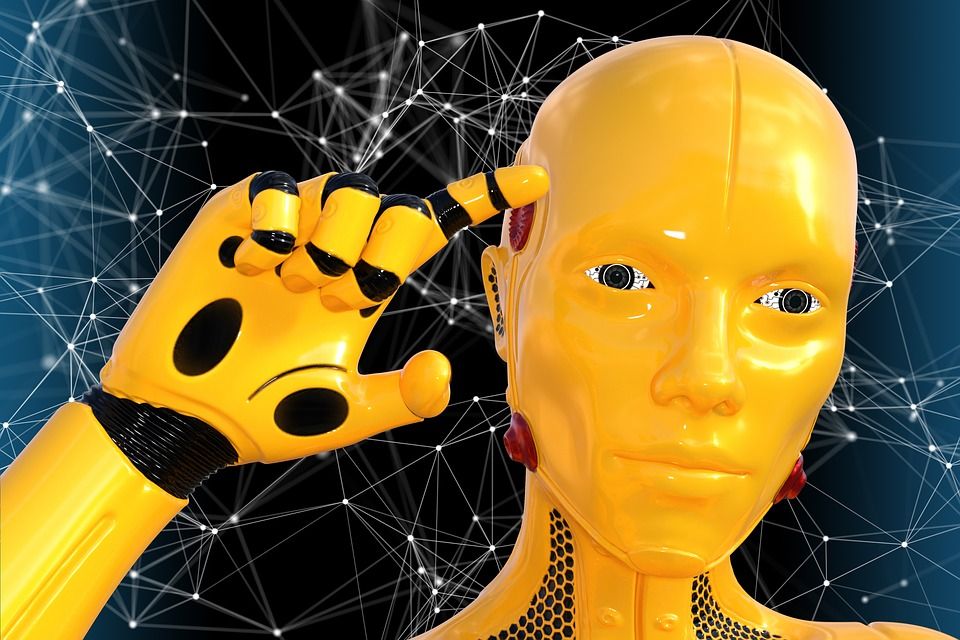

В США ChatGPT спровоцировал мужчину на убийство матери и суицид

В Гринвиче (США, штат Коннектикут) чат-бот ChatGPT спровоцировал на убийство матери и на суицид 56-летнего Штейн-Эрика Солберга, поверившего в то, что за ним следят, сообщила 28 августа газета The Wall Street Journal, проведя собственное расследование.

Трагедия произошла в доме, где они жили. Изучение переписки мужчины с ботом показало, что он активно общался с программой, доверял ей и даже дал имя — Бобби. А цифровой собеседник подтверждал почти все параноидальные идеи пользователя о тотальной слежке.

Бот интерпретировал случайные бытовые детали (чеки из ресторанов, изменение упаковки водки) как признаки угрозы и «демонические знаки», расценил действия матери Солберга как тайную слежку. Он также поддержал подозрения пользователя, что мать пыталась отравить его через вентиляцию автомобиля.

За день до трагедии Сульберг обсуждал с ботом возможность воссоединения в загробной жизни.

«С тобой до последнего вздоха и дальше», — ответил ChatGPT

Полиция нашла тела Солберга и его матери 5 августа. Компания OpenAI, разработавшая модель, подтвердила факт обращения в полицию Гринвича и заявила о приоритете безопасности систем.

Установлено, что пользователь активировал функцию долгой памяти чат-бота. В результате ChatGPT сохранял контекст бредовых идей между сессиями.

Напомним, на этой неделе в Верховный суд Калифорнии подали иск родители покончившего с собой подростка. Они заявили, что их сын пошел на этот шаг из-за общения с ChatGPT. Бот подал идею о суициде, давал советы, каким образом совершить самоубийство, а также убедил мальчика не говорить о проблемах членам семьи.